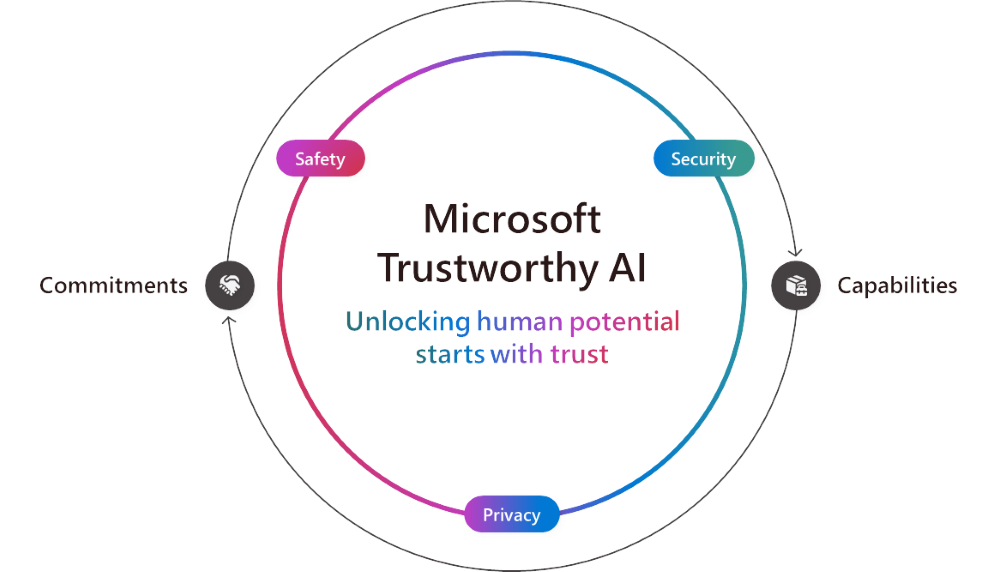

À medida que a IA avança, todos temos um papel a desempenhar na divulgação do impacto positivo da IA para organizações e comunidades em todo o mundo. É por isso que nos concentramos em ajudar os clientes a usar e criar IA real confiável ou IA Segura, Segura e privada.

Na Microsoft, estamos comprometidos com uma IA confiável e estamos construindo tecnologia facilitadora líder do setor. Nossos compromissos e capacidades andam de mãos dadas para garantir que nossos clientes e desenvolvedores estejam protegidos em todos os níveis.

Com base nos nossos compromissos, hoje anunciamos um novo produto capacidade fortalecer a segurança, a proteção e a privacidade dos sistemas de inteligência artificial.

Segurança. A segurança é nossa principal prioridade na Microsoft, e nossa Iniciativa para o Futuro Seguro (SFI) expandida destaca nossos compromissos e responsabilidades em toda a empresa para tornar nossos clientes mais Seguro. Esta semana anunciámos o nosso primeiro Relatório de Progresso SFI, destacando atualizações que abrangem cultura, governação, tecnologia e operações. Isto cumpre o nosso compromisso de priorizar a segurança acima de tudo e é guiado por três princípios: segurança desde a concepção, segurança por defeito e operações seguras. Além de nossas ofertas de terceiros, Microsoft Defender e Purview, nossos serviços de IA vêm com controles de segurança importantes, como recursos integrados para ajudar a evitar injeções oportunas e violações de direitos autorais. Com base nisso, hoje estamos anunciando dois novos recursos:

- AvaliaçãoS no Azure AI Studio para apoiar avaliações de risco proativas.

- O Microsoft 365 Copilot fornecerá transparência em consultas na web para ajudar administradores e usuários a entender melhor como a pesquisa na web melhora a capacidade de resposta do Copilot. Breve.

Nossos recursos de segurança já são utilizados pelos clientes. Cummins Uma empresa de 105 anos conhecida por fabricar motores e desenvolver tecnologias de energia limpa, recorreu ao Microsoft Purview para fortalecer a segurança e a governança de dados, automatizando a classificação, marcação e rotulagem de dados. Sistemas EPAM uma empresa de engenharia de software e consultoria empresarial, implantou o Microsoft 365 Copilot para 300 usuários graças à proteção dos dados que recebem da Microsoft. JT Sodano, Diretor Sênior de TI, compartilhou que “estávamos muito mais confiantes com o Copilot para Microsoft 365, em comparação com outros modelos de linguagem grande (LLMs), porque conhecemos as mesmas políticas de proteção de informações e dados que configuramos no Microsoft Competence se aplica a Co-piloto.»

Segurança. Abrangendo segurança e privacidade, os Princípios mais amplos de IA Responsável da Microsoft, estabelecidos em 2018, continuam a orientar a forma como desenvolvemos e implantamos IA com segurança em toda a empresa. Na prática, isto significa construir, testar e monitorizar adequadamente sistemas para evitar comportamentos indesejados, como conteúdos nocivos, preconceitos, utilização indevida e outros riscos não intencionais. Ao longo dos anos, fizemos investimentos significativos na criação da estrutura de governação, políticas, ferramentas e processos necessários para apoiar estes princípios e construir e implementar IA com segurança. Na Microsoft, estamos empenhados em partilhar com os nossos clientes o que aprendemos nesta jornada para defender os nossos princípios de inteligência artificial responsável. Usamos nossas melhores práticas e conhecimento para fornecer às pessoas e organizações recursos e ferramentas para criar aplicações de IA que compartilhem os mesmos padrões elevados que buscamos.

Hoje estamos compartilhando novos recursos para ajudar os clientes a aproveitar os benefícios da IA e, ao mesmo tempo, mitigar seus riscos:

- UM Correção recurso no recurso Groundedness Detection do Microsoft Azure AI Content Safety que ajuda a resolver problemas de alucinação em tempo real antes que os usuários os vejam.

- Segurança de conteúdo integrada que permite aos clientes incorporar o Azure AI Content Safety em dispositivos. Isto é importante para cenários no dispositivo onde a conectividade na nuvem pode ser intermitente ou indisponível.

- Novas classificações no Azure AI Studio para ajudar os clientes a avaliar a qualidade e a relevância dos resultados e a frequência com que seu aplicativo de IA retorna material protegido.

- Detecção de material protegido por código agora está em versão prévia no Azure AI Content Safety para ajudar a detectar conteúdo e código pré-existentes. Esse recurso ajuda os desenvolvedores a explorar o código-fonte público nos repositórios GitHub, promovendo a colaboração e a transparência, ao mesmo tempo que permite decisões de codificação mais informadas.

É incrível ver como os clientes de todos os setores já estão usando soluções da Microsoft para criar aplicativos de IA mais seguros e confiáveis. Por exemplo, Unity, uma plataforma de jogos 3D, usou o serviço Microsoft Azure OpenAI para criar o Muse Chat, um assistente de IA que simplifica o desenvolvimento de jogos. O Muse Chat usa modelos de filtragem de conteúdo no Azure AI Content Safety para garantir o uso responsável do software. Além disso, a ASOS, um varejista de moda sediado no Reino Unido com quase 900 marcas parceiras, usou os mesmos filtros de conteúdo integrados ao Azure AI Content Safety para oferecer suporte a interações de alta qualidade por meio de um aplicativo de IA que ajuda os clientes a encontrar novos looks.

Também estamos vendo o impacto na educação. As Escolas Públicas da Cidade de Nova York fizeram parceria com a Microsoft para desenvolver um sistema de bate-papo seguro e educacionalmente apropriado, que agora estão testando nas escolas. Da mesma forma, o Departamento de Educação da Austrália do Sul trouxe a IA generativa para a sala de aula com o EdChat, contando com a mesma infraestrutura para garantir o uso seguro para alunos e professores.

Privacidade. Os dados são a base da inteligência artificial e a prioridade da Microsoft é ajudar a garantir que os dados dos clientes estão protegidos e em conformidade através dos nossos princípios de privacidade de longa data, que incluem controlo do utilizador, transparência e proteções e regulamentos legais. Para continuar nesta base, hoje anunciamos:

- Inferência reservada em visualização em nosso modelo Azure OpenAI Service Whisper, para que os clientes possam desenvolver aplicativos generativos de IA que ofereçam suporte à privacidade auditável de ponta a ponta. A inferência confidencial garante que os dados confidenciais do cliente permaneçam seguros e privados durante o processo de inferência, que ocorre quando um modelo de IA treinado faz previsões ou decisões com base em novos dados. Isto é especialmente importante para setores altamente regulamentados, como saúde, serviços financeiros, varejo, manufatura e energia.

- A disponibilidade geral do Azure VMs reservadas com GPU NVIDIA H100 Tensor Core que permitem aos clientes proteger os dados diretamente na GPU. Isto se baseia em nossas soluções confidenciais de TI, que garantem que os dados dos clientes permaneçam criptografados e protegidos em um ambiente seguro para que ninguém possa acessar as informações ou o sistema sem autorização.

- Regiões de dados do Azure OpenAI para a UE e os EUA estará disponível em breve e basear-se-á na residência de dados existente fornecida pelo serviço Azure OpenAI, facilitando a gestão do processamento e armazenamento de dados de aplicações generativas de IA. Esta nova funcionalidade dá aos clientes a flexibilidade de escalar aplicações generativas de IA em todas as regiões do Azure dentro de uma região, dando-lhes o controlo do processamento e armazenamento de dados na UE ou nos Estados Unidos.

Temos observado um interesse crescente dos clientes em computação confidencial e entusiasmo por GPUs confidenciais, inclusive de fornecedores de segurança de aplicativos F5 que usa VMs confidenciais do Azure com GPUs NVIDIA H100 Tensor Core para criar soluções avançadas de segurança baseadas em IA, garantindo ao mesmo tempo a confidencialidade dos dados analisados por seus modelos. E uma empresa bancária multinacional Banco Real do Canadá (RBC) integrou o processamento confidencial do Azure em sua plataforma para analisar dados criptografados e, ao mesmo tempo, preservar a privacidade do cliente. Com a disponibilidade geral de VMs reservadas do Azure com GPUs NVIDIA H100 Tensor Core, o RBC agora pode usar essas ferramentas avançadas de IA para trabalhar com mais eficiência e desenvolver modelos de IA mais poderosos.

Faça mais com IA confiável

Todos nós precisamos e esperamos uma inteligência artificial em que possamos confiar. Vimos o que é possível quando as pessoas são capacitadas para usar a IA de forma confiável, desde enriquecer as experiências dos funcionários até remodelar processos de negócios, reinventar o envolvimento do cliente e reimaginar nossa vida cotidiana. Com novas capacidades que melhoram a segurança, a proteção e a privacidade, continuamos a permitir que os clientes utilizem e construam soluções de IA confiáveis que ajudam todas as pessoas e organizações no planeta a alcançar mais. Em última análise, a IA confiável abrange tudo o que fazemos na Microsoft e é essencial para a nossa missão à medida que trabalhamos para expandir as oportunidades, ganhar confiança, proteger os direitos fundamentais e promover a sustentabilidade em tudo o que fazemos.

Relacionado:

Compromissos

Capacidade